El acceso al mercado estadounidense y a los de Asia le permitió a Vietnam acelerar su transformación en una economía orientada a la exportación y basada en la fabricación de manufacturas y productos agrícolas.

Desde el inicio de la reforma económica de Vietnam en 1986 se hizo evidente que el país debía hacer un esfuerzo para lograr nuevos acuerdos internacionales e integrarse a los distintos foros y organismos regionales y mundiales.

La firma del 13 de julio de 2000 del Acuerdo Comercial Bilateral (BTA) entre Estados Unidos y Vietnam fue un hito importante para la economía de este país La BTA preveía el estatus de Relaciones Comerciales Normales (NTR) de los productos vietnamitas en el mercado estadounidense.

El acceso al mercado estadounidense y a los de Asia le permitió a Vietnam acelerar su transformación en una economía orientada a la exportación y basada en la fabricación de manufacturas y productos agrícolas. También atrajo inversión extranjera, pero no solo de Estados Unidos, sino también de Europa y, especialmente, de Asia y otras regiones.

El 11 de enero de 2007, Vietnam se convirtió en el 150º miembro de la OMC. El acceso de Vietnam a la OMC proporcionó un impulso importante a la economía de Vietnam y ayudó a asegurar la continuación de las reformas liberalizadoras y la creación de opciones para la expansión comercial.

Cartel de bienvenida a Vietnam en la sede de la OMC en Ginebra en 2007.

Atraer inversión extranjera

En 2001 los ingresos de Vietnam a través de su comercio con Estados Unidos, superaron los mil millones de dólares tras la firma del BTA y llegaron a los 11 mil millones de dólares en 2008 tras el ingreso de Vietnam a la Organización Mundial del Comercio (OMC).

Como parte de su política exterior Vietnam comenzaría desde el inicio, un proceso de fuerte atracción a la Inversión Extranjera Directa (IED), concebida como un proceso controlado por el Estado para obtener capital y tecnologías de avanzada; introducir nuevas formas de gestión empresarial que contribuyeran a elevar la eficiencia y calidad de las producciones; y combinar todo esto con un uso más racional de las potencialidades y recursos existentes.

Todo esto de manera que se correspondiera con la estrategia de desarrollo económico y social del país. En 1987 se promulga una Ley para la Inversión Extranjera Directa y en 2005 se aprueba una nueva Ley de Inversiones que permitió la inversión privada.

En un inicio se mantuvieron ciertas restricciones a la IED en las personas naturales del país, pero en relación con quiénes invertían por la parte extranjera; sólo en el caso de los emigrados que tuvieran causas pendientes con la justicia vietnamita. Se estimuló la participación de los vietnamitas residentes en el exterior ”como su contribución a la reconstrucción nacional”.

Acercamiento entre Estados Unidos y Vietnam

Después de la guerra entre Estados Unidos y Vietnam del Norte, el gobierno vietnamita prosiguió el establecimiento de relaciones diplomáticas con es país, inicialmente enfocados en obtener 3 300 millones de dólares en ayuda para la reconstrucción que el presidente Richard M. Nixon había prometido después de la firma del Acuerdo de Paz de París en 1973.

De conformidad con el artículo 21 de ese Acuerdo, Estados Unidos se había comprometido a ”contribuir a curar las heridas de guerra y a la reconstrucción de la República Democrática de Vietnam, después de la guerra…”. Pero se había evitado específicamente el uso de terminología que podría interpretarse como que las reparaciones se ofrecían por daños de guerra.

Firma del Acuerdo de Paz de París, 1973.

Vietnamitas en París saludan el Acuerdo de Paz de París.

La promesa de Nixon fue en forma de carta, confirmando la intención del Artículo 21 y ofreciendo una figura específica. Dos meses después de la victoria de Hanoi en 1975, el Primer Ministro Pham Van Dong, hablando ante la Asamblea Nacional, invitó a los Estados Unidos a normalizar las relaciones con Vietnam y a cumplir con su compromiso de proporcionar fondos para la reconstrucción.

Art. 1. Estados Unidos y todos los demás países respetan la independencia, soberanía, unidad e integridad territorial de Vietnam, como se reconoció en los Acuerdos de Ginebra sobre Vietnam en 1954.

Se invitó también a representantes de dos bancos estadounidenses, el Bank of America y el First National City Bank, a discutir las posibilidades comerciales, y se informó a las compañías petroleras estadounidenses que podían solicitar concesiones para buscar petróleo en las aguas vietnamitas de la costa. “Lo más completa posible”

Sin embargo, Washington ignoró el llamado del primer ministro Phan Van Dong para el establecimiento de relaciones normales porque se basaba en ”reparaciones”, y el clima político de Washington a raíz de la guerra impidió la búsqueda de tal resultado.

En respuesta, la administración del presidente Gerald R. Ford impuso su propia condición previa para las relaciones normales al anunciar que se requeriría un informe completo de los estadounidenses desaparecidos en acción, incluida la devolución de cualquier resto, antes de que se pudiera llevar a cabo la normalización.

No se hicieron concesiones en ninguno de los dos lados hasta que el presidente Jimmy Carter, pudo suavizar la demanda de los Estados Unidos de una “contabilidad completa” a una “contabilidad lo más completa posible” y envió una misión a Hanoi en 1977 para iniciar las conversaciones de normalización.

Los vietnamitas al principio tuvieron reticencias con respecto a la asistencia económica de Estados Unidos —su primer plan económico de posguerra contó con la cantidad prometida por el presidente Nixon. Ese condicionamiento se relativizó a mediados de 1978 cuando Hanoi hizo gestos adicionales hacia las relaciones normales.

En ese momento, el ministro de Relaciones Exteriores de Vietnam, Nguyen Co Thach, y el gobierno de los Estados Unidos llegaron a un acuerdo de principio sobre la normalización, pero la fecha fue imprecisa. Cuando Thach instó a que fuera en noviembre de 1978, una fecha que, en retrospectiva, era significativa porque tenía previsto en Moscú firmar el Tratado de Amistad y Cooperación con la Unión Soviética, Washington no se comprometió.

En una entrevista con un periodista danés en 1984, Co Thach explicó su perspectiva sobre las relaciones que Vietnam deseaba tener con Occidente y con Estados Unidos:

Sabemos quiénes son nuestros amigos en este mundo, pero no deseamos tener enemigos entre los países occidentales ni en otros lugares. Permítanme darles un ejemplo: en 1976, Vietnam se convirtió en miembro del Banco Mundial. Los países occidentales nos recibieron con gran alegría en el banco.

En 1979, cuando Estados Unidos y sus aliados instigaron el bloqueo económico contra Vietnam, solicitamos ser miembros del COMECOM, la organización para la cooperación económica entre los países socialistas.

Por principio, nos gustaría tener una relación cordial con los EE.UU. y todos los demás países del mundo. Actualmente Vietnam es miembro del Banco Mundial, aunque no nos beneficiamos de los programas del banco ni del COMECON.

No nos estamos aislando de otros sistemas políticos o económicos.

¿China en lugar de con Vietnam?

Los dirigentes políticos en Hanoi comprendieron que Estados Unidos había optado por fortalecer sus vínculos con China en lugar de con Vietnam, y se movilizaron para formalizar sus vínculos con los soviéticos en respuesta. Sin embargo, su esperanza original había sido obtener el reconocimiento diplomático de los Estados Unidos y un tratado de amistad con Moscú, como una doble garantía contra una futura interferencia china.

Cualquier esfuerzo por mejorar las relaciones entre los dos países permaneció estrechamente ligado a la voluntad de los Estados Unidos de cumplir con su compromiso de 1973 con Vietnam y con el hecho de que Hanoi no respondiera acerca del paradero de los más de 2400 desaparecidos norteamericanos en su territorio.

En 1978, el gobierno vietnamita dejó de insistir en que las cuestiones de ayuda y desaparecidos se resolvieran como una condición previa para la normalización y permitió la excavación conjunta entre los Estados Unidos y Vietnam de un sitio del accidente de un B-52 en 1985 y paulatinamente fue devolviendo los restos de los militares de Estados Unidos.

De la política hostil a la asistencia humanitaria

En 1986 se celebró el Sexto Congreso del Partido Comunista de Vietnam y se le prestó poca atención a las relaciones con Estados Unidos, el informe del Congreso señaló que Vietnam continuaba manteniendo conversaciones con Washington sobre temas humanitarios y expresaba su disposición a mejorar las relaciones.

El mensaje de este Congreso era más en positivo que el informe del Quinto Congreso del Partido de 1982, que atribuyó la relación estancada a la ”política hostil” de Washington. La redacción mejorada fue atribuible a la influencia del recién nombrado Secretario General del Partido, Nguyen Van Linh, de quien se esperaba que asignara una alta prioridad a la expansión de los vínculos de Vietnam con Occidente.

Durante la administración del presidente Ronald Reagan, Estados Unidos continuó aplicando el bloqueo comercial impuesto a Hanoi en 1975 y prohibió los lazos normales mientras las tropas vietnamitas ocuparan Camboya.

Una reunión entre los líderes vietnamitas y el enviado especial del presidente Reagan para el tema de los desaparecidos, el general John W. Vessey, en agosto de 1987, produjo importantes avances para ambas partes en ese tema y fue entonces que Estados Unidos acordó comenzar la asistencia humanitaria para Vietnam.

El camino de la normalización de relaciones con Estados Unidos

El presidente de Estados Unidos, Bill Clinton, el 11 de julio de 1995, anunció el levantamiento del bloqueo económico a Vietnam impuesto por 30 años, junto a la apertura en Hanoi y Washington de ”oficinas de enlace”, lo que fue el comienzo hacia la normalización de relaciones con un país al que Estados Unidos se enfrentó en una de las guerras más cruentas y que más huella ha dejado en la historia estadounidense, con más de 58 mil bajas.

El propio Clinton expresó en esa ocasión que el levantamiento del bloqueo era ”el mejor medio de resolver las dudas sobre la suerte de los que todavía se encuentran desaparecidos”.1

Más allá del recuerdo de los fallecidos y sobrevivientes en la opinión pública de Estados Unidos, el levantamiento del bloqueo tuvo como unos de sus objetivos principales hacer desaparecer la barrera política que dificultaba en ese momento el acceso a un importante mercado, en plena fase de desarrollo y, por lo tanto, muy atractivo para los inversores.

Técnicos estadounidenses en planes de inversión y representantes de asesorías comerciales llevaban ya varios años trabajando en Hanoi para explorar las diferentes formas de colaboración económica, antes de ese anuncio.

Las relaciones con Vietnam tenían, además, un interés estratégico, ya que servirían como contrapeso de otros poderes emergentes en la zona, especialmente China.

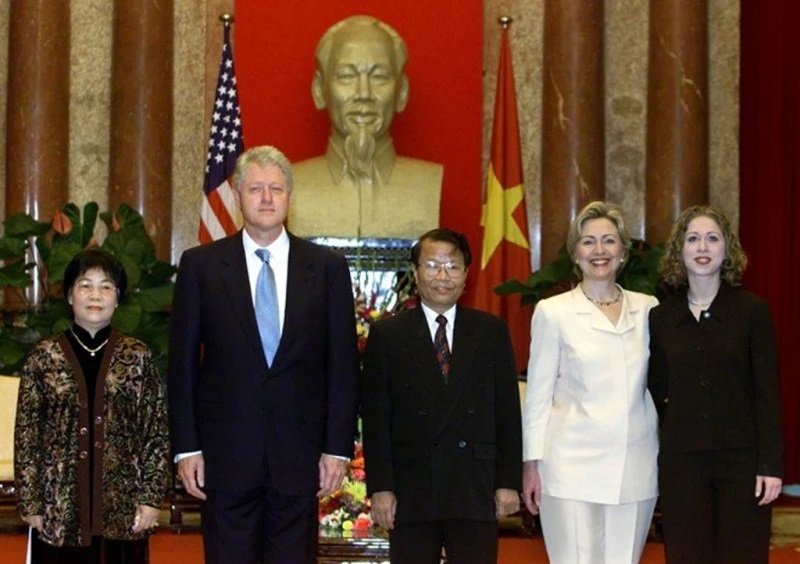

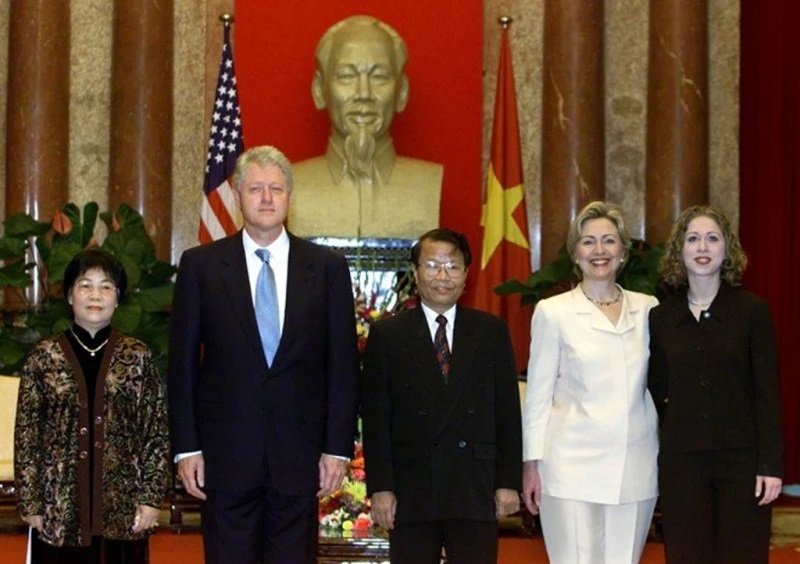

Clinton en Vietnam

En noviembre de 2000 el presidente William Clinton protagonizó una histórica visita a Vietnam, la primera de un presidente de Estados Unidos después de la derrota de sus tropas.

Una crónica sobre estos hechos publicada entonces en el diario El País lo narraba de este modo: “Los portavoces estadounidenses insisten en la idea de que ‘Vietnam es un país, no una guerra’. Sin embargo, lo que en realidad es ahora Vietnam es un gran negocio y uno de los mercados más florecientes de Asia.”

El presidente vietnamita Tran Duc Luong recibe a su homólogo William Clinton, la primera dama Hillary Clinton y su hija Chelsea.

Clinton siempre estuvo a favor del levantamiento del embargo a Vietnam dentro de su política de apertura de mercados a los productos norteamericanos por encima de las diferencias políticas, una línea de actuación especialmente aplicada en Asia.

La decisión de la Casa Blanca fue favorecida por el Senado tras aprobar por clara mayoría la propuesta para acabar con el bloqueo impuesto a Vietnam del Norte en 1964 y extendido a todo Vietnam tras el final de la guerra, en 1975. ¿Cómo se llegó hasta allí?

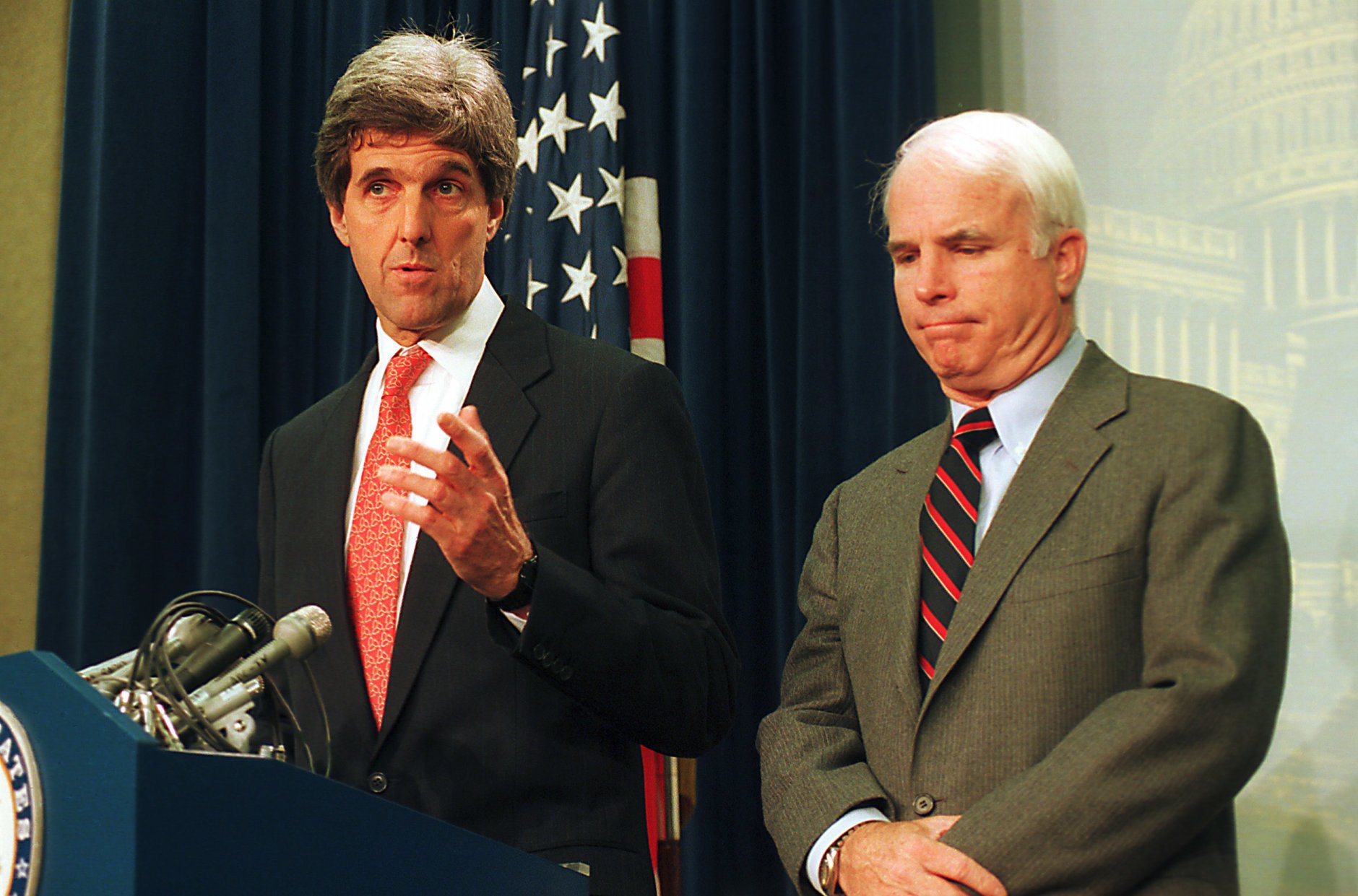

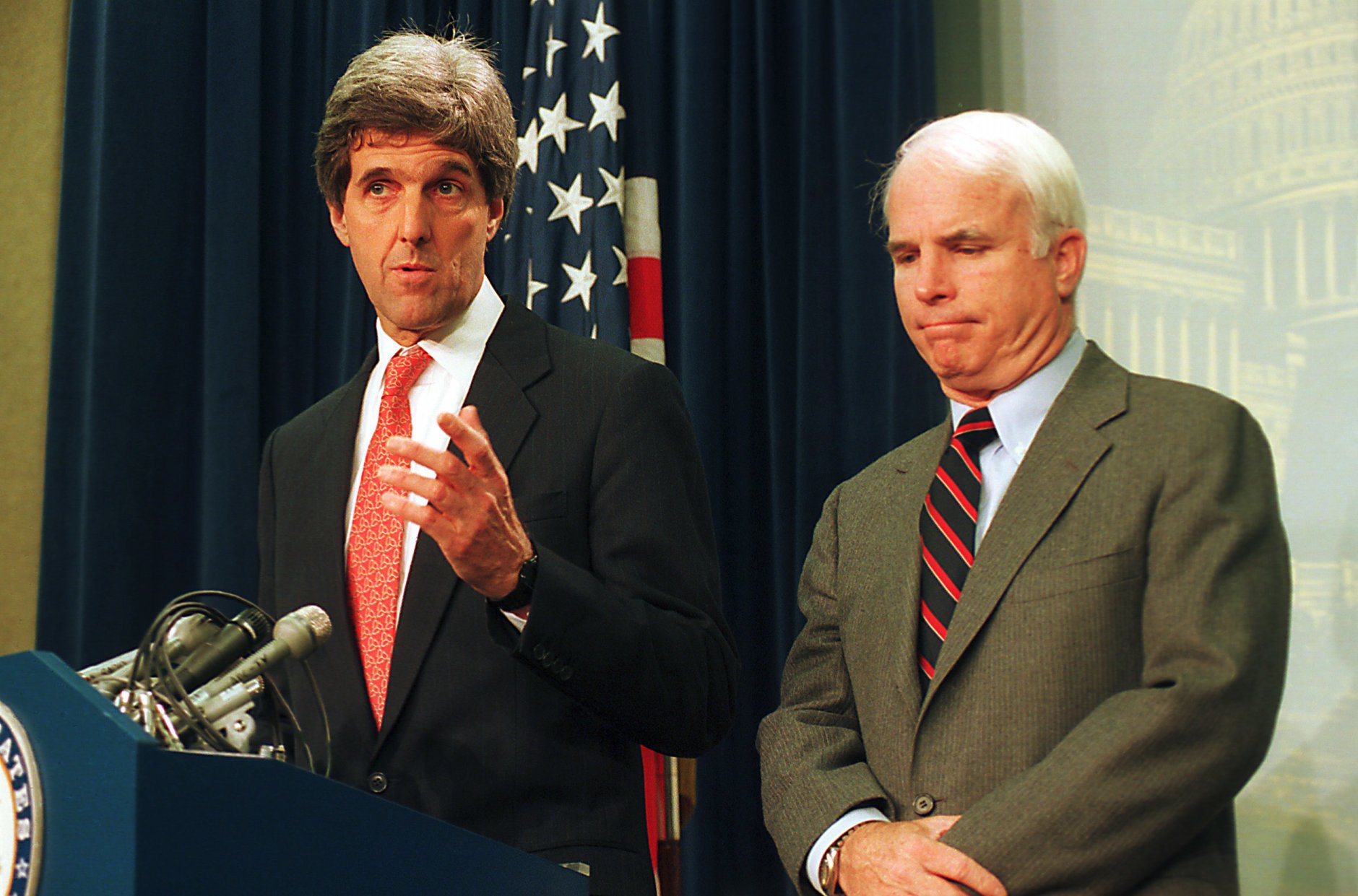

Kerry y McCain, viejos soldados

La influencia de los veteranos de la guerra de Vietnam John McCain y John Kerry sobre Bill Clinton fue fundamental en la decisión de la administración Clinton de levantar el bloqueo comercial contra Vietnam.2

Tanto Kerry como McCain eran veteranos de guerra y congresistas condecorados que formaban parte del Comité Selecto del Senado sobre los Asuntos P.O.W./M.I.A (desaparecidos en combate).

El tema de los soldados estadounidenses desaparecidos era para ellos fundamental y estaban muy familiarizados con él: viajaban frecuentemente a Vietnam y coordinaban con los funcionarios del gobierno vietnamita.

Tras años de debates públicos en los Estados Unidos sobre el destino de los militares desaparecidos, así como por el progreso del gobierno vietnamita en el cumplimiento de las demandas estadounidenses relacionadas, Kerry y McCain comenzaron a abogar por levantar el bloqueo.

El senador John Kerry, demócrata por Massachusetts y el senadro John MacCain, republicano por Arizona, durante una conferencia de prensa ofrecida el 27 de enero de 1994 después de una votación del Senado en la que instó a la administración Clinton a levantar el embargo comercial contra Vietnam. Foto: John Duricka/AP.

McCain y Kerry se reunieron personalmente con Clinton varias veces para promover el levantamiento del bloqueo. En una conversación con el presidente, McCain dijo: ”Ya no me importa, señor Presidente, que yo estaba a favor de la guerra y estaba también en contra de la guerra. Estoy cansado de mirar hacia atrás con ira. Lo importante es que avancemos ahora”. Al argumentar su caso a Clinton, los senadores ”ofrecieron razones geopolíticas y económicas, pero también enfatizaron el tema del honor nacional, ya que los vietnamitas habían hecho diligentemente todo lo que les habíamos pedido en el asunto de los soldados.”

Los esfuerzos de Kerry y McCain contribuyeron a crear el capital político y el consenso necesario para que la administración Clinton llegara a levantar el bloqueo.3

En 1993, Kerry y McCain acompañaron a Clinton al Monumento a los Veteranos de Vietnam, a pesar de la oposición sustancial de los grupos de veteranos. Más tarde, en 1994, Kerry y McCain fueron co-patrocinadores de una resolución bipartidista del Senado que instaba a la administración Clinton a levantar el bloqueo.

Un evento seminal

A pesar de la importante oposición de los líderes republicanos y los grupos de veteranos, ”el patrocinio de McCain persuadió a veinte republicanos a votar por la medida, que fue aprobada por una votación de sesenta y dos a treinta y ocho”.

Mientras desarrollaba el proyecto de ley, Kerry estaba en comunicación frecuente con los funcionarios de la administración Clinton. Después de la votación, Kerry enfatizó la promoción de la sanidad nacional y declaró que ”era hora de dejar atrás la guerra”.

Del mismo modo, McCain consideraba la resolución del Senado como ”como un evento seminal en las relaciones vietnamitas de Estados Unidos”, y agregó que ”la votación le dará al Presidente la cobertura política que necesita para levantar el embargo”.

El bloqueo de Estados Unidos a Vietnam finalmente se levantó en febrero de 1994. La normalización formal de las relaciones diplomáticas entre los Estados Unidos y Vietnam se llevó a cabo en 1995, seguida de un auge del comercio entre los dos países en los años subsiguientes.4

En el plano militar

En 1997, el presidente Clinton nombró al primer embajador de Estados Unidos en Vietnam: Douglas ”Pete” Peterson, piloto en Vietnam quien fue capturado y pasó seis años prisionero del ejército de Vietnam del Norte. A partir de ahí comenzó un intercambio fluido, que alcanzó hasta la esfera militar, unos diez años después.

Vietnam recibió visitas de buques de la Marina de Guerra estadounidense en 2007, incluida una entrada de puerto a Da Nang por el barco de asalto anfibio USS Peleliu (LHA-5) con un contingente multinacional de personal médico e ingenieros.

En junio de 2007, los observadores vietnamitas formaron parte por primera vez en el ejercicio naval multinacional Cooperación para la preparación y entrenamiento a bordo (CARAT), organizado por la Marina de los Estados Unidos.

En octubre de 2013, Estados Unidos y Vietnam firmaron un pacto que permitía la transferencia de combustible nuclear y tecnología de los Estados Unidos a Vietnam, que ya venía trabajando con Rusia para completar su primera planta nuclear en 2014 con el propósito de cumplir con su demanda creciente de energía.

A principios de octubre de 2014, Estados Unidos aprobó una relajación de su antiguo embargo de armas a Vietnam. El presidente Obama anunció el levantamiento total del embargo de armas durante su visita a Vietnam en mayo de 2016.

Visitas presidenciales: ni uno solo ha faltado

Desde que Vietnam y Estados Unidos normalizaron sus relaciones en 1995, se han sucedido vistas de Estado a Hanoi de todos los presidentes estadounidenses, sin excepción, y alguno en más de una ocasión, siempre con el propósito de estrechar lazos económicos y comerciales, ampliar la cooperación en distintos ámbitos y ejercer una diplomacia activa en la región.

George W.Bush: “donde nunca ha estado”

El republicano George W. Bush llegó en noviembre de 2006 a Hanoi para asistir a la 21 Cumbre de presidentes y jefes de estado del Foro de Cooperación Económica Asia-Pacífico. Según un funcionario de la Casa Blanca, Bush estaba “muy deseoso de ver Vietnam, donde nunca ha estado. Tiene muchas ganas de ver los cambios que se han producido, la explosión económica”.

El presidente George W. Bush y la primera dama Laura Bush se unen al Presidente vietnamita Nguyen Minh Triet y a la Sra. Tran Thi Kim Chi en el Gran Salón del Palacio Presidencial el viernes 17 de noviembre de 2006, después de llegar a Hanoi para la Cumbre del APEC de 2006. Foto: Eric Draper.

A más de tres años de iniciada la guerra en Irak Bush utilizó la memoria de la guerra en Vietnam para reprochar a los que exigían la retirada de Estados Unidos: “ganaremos si no abandonamos”, en alusión al final del conflicto en el país indochino.

Bush fue recibido por el presidente y el primer ministro del país, Nguyen Mihn Triet y Nguyen Tan Dung; así como por el secretario general del Partido Comunista vietnamita, Nong Duc Man.

“He podido ver de primera mano la vitalidad y el movimiento que tiene lugar en Vietnam. Es como un tigre joven, y tengo muchas ganas de continuar nuestra colaboración para garantizar que nuestras relaciones bilaterales se mantienen cercanas”, declaró Bush.

Obama: los rascacielos de Hanoi

Pocas semanas después de haber visitado Cuba, Barack Obama también realizó una visita a Vietnam, en mayo de 2016 —su último año en la Casa Blanca. Llegaba a un país de 94 millones de habitantes con un crecimiento anual del PIB de 7 %. Estados Unidos era el principal comprador de las exportaciones vietnamitas.

En su discurso más importante durante la visita resaltó el desarrollo alcanzado por el país:

Vietnam ha logrado enormes avances, y hoy el mundo puede ver los avances que ustedes han logrado. Con reformas económicas y acuerdos comerciales, incluso con Estados Unidos, ustedes han ingresado a la economía global y venden sus productos en todo el mundo. Está llegando más inversión extranjera. Y con una de las economías de más rápido crecimiento en Asia, Vietnam ha ascendido hasta convertirse en una nación de ingresos medios.

Vemos el progreso de Vietnam en los rascacielos de Hanoi y ciudad Ho Chi Minh, y en los nuevos centros comerciales y centros urbanos.

Un punto muy relevante de su visita fue la colaboración en materia militar:

(…) Con esta visita, hemos acordado elevar nuestra cooperación en materia de seguridad y generar más confianza entre nuestros hombres y mujeres uniformados. Continuaremos ofreciendo capacitación y equipo a su Guardia Costera para mejorar las capacidades marítimas de Vietnam. Nos asociaremos para brindar ayuda humanitaria en tiempos de desastres. Con el anuncio que hice ayer de levantar por completo la prohibición de las ventas de productos de defensa, Vietnam tendrá un mayor acceso al equipo militar que necesita para garantizar su seguridad. Y Estados Unidos está demostrando nuestro compromiso de normalizar plenamente nuestra relación con Vietnam.

Un hombre sostiene un poster relativo a la visita de Obama a Vietnam. Foto: Reuters.

“Silla de plástico, baratos pero deliciosos fideos, cerveza Hanoi helada. Así recordaré a Tony. Él nos enseño sobre comida, pero más importante, sobre su habilidad de reunir gente. Por tener un poquito menos de miedo a lo desconocido. Te extrañaremos”, escribió Obama en un tuit tras el suicidio del chef Anthony Bourdain en 2018, y que lo acompañara en esta mesa en Hanoi en 2016.

Trump, veces dos

En noviembre de 2017, a menos de un año de estrenarse como presidente, Donald Trump realizó su primera visita oficial a Vietnam. En enero de ese mismo año, su administración había decidido retirarse como signatario del Acuerdo de Asociación Transpacífico (TPP), ausentarse de las negociaciones y, en cambio, intentar favorecer las negociaciones comerciales bilaterales.

El presidente Donald Trump junto al presidente Tran Dai Quang. Foto: East Asi Forum.

Hanoi, dada sus buenas relaciones tanto con Washington como con Pionyang y su cercanía geográfica con Corea del Norte, fue elegida como sede de la segunda cumbre Trump-King Jong en febrero de 2019. Su modelo económico exitoso y su experiencia en la reunificación de un país dividido completaban su idoneidad para acoger a ambos líderes que, por cierto, no consiguieron ningún avance tras ese encuentro donde el tema principal era la posible desnuclearización de Corea del Norte.

Kamala Harris: mirando a China

En agosto de 2021, todavía teniendo que utilizar mascarilla y aún dentro de la tormenta pandémica global por el Covid-19, la vicepresidenta de Estados Unidos Kamala Harris viajó también a Vietnam, como una parada de una gira por Asia.

Harris ofreció apoyo para la seguridad marítima, en la intención de arrimar a Vietnam como aliado en la confrontación con China. “Necesitamos encontrar formas de presionar, aumentar la presión (…) Para que Beijing cumpla con la Convención de las Naciones Unidas sobre el Derecho del Mar y se desafíe su intimidación y reclamos marítimos excesivos”, sostuvo la vicemandataria estadounidense.

Fue una visita durante la cual quedó mucho más clara que las relaciones Estados Unidos-Vietnam deben analizarse “como una triangulación Estados Unidos-Vietnam-China”, tal como analiza el investigador Ruvislei González Saez: “Hanoi evita caer en un conflicto entre dos grandes potencias y promueve el equilibrio estratégico.”

En el mismo artículo González Saez cita el Libro Blanco de Defensa 2019 en el que Vietnam declaraba que “no se unirá a ninguna alianza militar, no se asociará con una de las partes para oponerse a otra y no permitirá que ningún país extranjero establezca una base militar en el país”.

Joe Biden en Vietnam y la asociación estratégica

En septiembre de 2023 el presidente Joe Biden realizó una visita a Vietnam de la que emergió la firma de un Acuerdo de Asociación Estratégica Integral que elevó a un nivel superior las relaciones entre los dos países. Uno de los pilares esenciales de este Acuerdo es impulsar la producción de semiconductores en Vietnam, el segundo país después de China con las mayores disponibilidades de “tierras raras”.

El presidente Joe Biden, brinda durante el almuerzo de Estado con el presidente de Vietnam, Vo Van Thuong, en Hanoi. Foto: Evan Vucci/AP.

Esta visita de Biden fue caracterizada como la más importante junto a la de Clinton en 2000. La invitación fue realizada por el secretario general del Partido Comunista de Vietnam (PCV), Nguyen Phu Trong, máxima autoridad del país.

Con el Acuerdo de Asociación Estratégica las relaciones con Estados Unidos se llevaron al mismo nivel que las que mantiene Vietnam con China, Rusia, India y Corea del Sur.

“Vietnam ha desplegado en los últimos tiempos una diplomacia del bambú heredera de la sabiduría de Ho Chi Minh caracterizada por el pragmatismo, pero sin romper el sentido de la política exterior independiente, soberana y bajo el liderazgo del Partido. Eleva los lazos en su propio beneficio con las mayores potencias del mundo al mismo nivel, pero a la vez, está abriendo paso hacia nuevos retos que deberá enfrentar al mediano y al largo plazo.”5

Notas:

2. Castelli, Beth. ”The Lifting of the Trade Embargo Between the United States and Vietnam: The Loss of a Potential Bargaining Tool or a Means of Fostering Cooperation?”, Penn State International Law Review, vol. 13, 1 Jan. 1995.

4. Napier, Nancy K.; Vuong, Quan Hoang (2013). What we see, why we worry, why we hope: Vietnam going forward. Boise, ID, USA: Boise State University CCI Press. p. 140.